|

石家庄达内IT教育 |

4000336017

4000336017位置:搜学搜课 > 新闻 > Python爬虫怎么学分哪几个阶段

Python是一种通用的脚本开发语言,比其他编程语言更加简单、易学,其面向对象特性甚至比Java、C#、.NET更加彻底,因此非常适合开发。Python在软件质量控制、开发效率、可移植性、组件集成、库支持等方面均具有明显的优势。

行业

人才需求量大

|

前景

跟上人工智能时代的步伐

|

就业

就业领域广,就业方向多!

|

简单易学: 逻辑简单,语法更贴近英语,初中水平英语即可入门初级 Python工程师, Python的“前景广阔”却又“简单易学”吸引了不少低龄开发者;

0元开源: 逻Python开放源代码,共享时代,让 python变得更简单;

标 准 库: Python拥有强大易用的标准库,让编程更方便

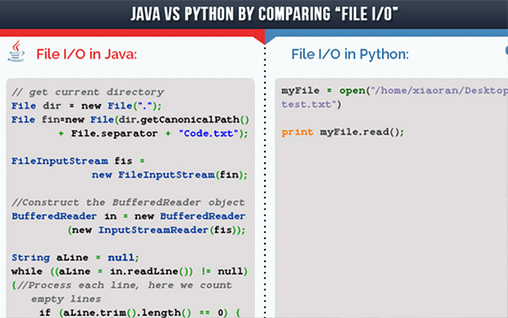

代码极短: 相同功能 Java VS Python代码数量对比,结果显而易见

一码多用: 可以用相同的代码处理不同规模的数据,达到用户的需求。

Our Courses

Our Teaching

讲师团队提供项目

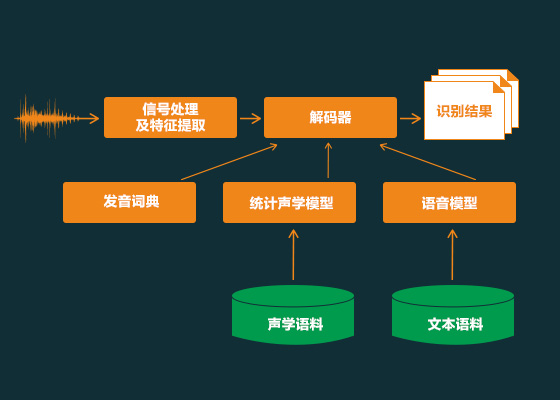

| 项目一:东方财富智能云系统 | 项目二:爬虫集群系统 | 项目三:语音识别 |

|

|

|

| 项目简介 | ||

| 在线金融交易系统,通过实时获取上证、深证所提供的证券金融数据,进行智能分析、显示,较终按照用户制定的交易策略进行虚拟交易。 | 通过对海量招聘数据挖掘、分析,帮助求职者更快更好的找到适合的工作。可以按照城市、薪资、行业、其他技能关键字等进行合理分析,较终得出有价值的结果。 | 采用Google的TensorFlow人工智能学习系统建立的智能语音识别系统。通过学习该项目,希望学员早日走入人工智能的大门。 |

| 技能掌握 | ||

|

1、Python核心技术,网络编程技术。 2、WEB前端开发技术:HTML5、CSS、Javascript、JQuery库、网页设计技能。 3、多种网络协议及数据格式,如:HTTP协议、JSCON。 4、数据库技术:MySql、MongoDB、Redis。 5、Django Web框架技术 6、Python SMTP smtplib、email模块 7、Python项目部署、测试技术 8、软件工程管理技能、Git、Pydoc等工具使用 |

1、熟练使用Python urllib requests等模块 2、掌握Python网络编程、多线程编程技术 3、掌握XML解析、XPath 语法,以及Python的re、json模块 4、掌握网络协议,如HTTP协议 5、理解分布式爬虫原理及实现 6、熟练使用Scrapy框架,及scrapy-redis分布式框架 |

1、掌握采用Tornado框架实现高并发请求技能。 2、掌握海量数据分析技术。 3、掌握语音识别技术原理、实现方法。 4、掌握采用Python作为开发语言的人工智能框架TensorFlow。 5、掌握第三方SDK的使用,如微软语音、百度语音的Python SDK。 6、掌握数据的云端存取访问技术 7、掌握Python图形编程技术。 |

诚信经营,拒绝虚假宣传是达内公司的经营理念。达内公司将在学员报名之前公布公开所有授课讲师的安排 及背景资料,并郑重公布《指定授课讲师承诺书》,确保学员利益。

学习Python编程的人很多,有的人学完之后做了AI算法工程师,有的做了Python开发工程师,有的做了Python数据分析工程师,当然也有的做了Python爬虫工程师,今天我们就来看看Python爬虫怎么学,分为哪几个学习阶段吧。

Python爬虫怎么学?分哪几个阶段?

如果你仔细观察,就不难发现,懂爬虫、学习爬虫的人越来越多,一方面,互联网可以获取的数据越来越多,另一方面,像Python这样的编程语言提供越来越多的工具,让爬虫变得简单、容易上手。

对于小白来说,爬虫可能是一件非常复杂、技术门槛很高的事情。比如有的人认为学爬虫必须精通Python,然后哼哧哼哧系统学习Python的每个知识点,很久之后发现仍然爬不了数据;有的人则认为先要掌握网页的知识,遂开始HTMLCSS,结果入了前端的坑,瘁……

但掌握正确的方法,在短时间内做到能够爬取主流网站的数据,其实非常容易实现。但建议你从一开始就要有一个具体的目标,你要爬取哪个网站的哪些数据,达到什么量级。

那些所有你认为必须的前置知识,都是可以在完成目标的过程中学到的。这里给你一条平滑的、基础差入门的学习路径。

学习Python包并实现基本的爬虫过程

大部分爬虫都是按“发送请求——获得页面——解析页面——抽取并储存内容”这样的流程来进行,这其实也是模拟了我们使用浏览器获取网页信息的过程。

Python中爬虫相关的包很多:urllib、requests、bs4、scrapy、pyspider等,建议从requests+Xpath开始,requests负责连接网站,返回网页,Xpath用于解析网页,便于抽取数据。

如果你用过BeautifulSoup,会发现Xpath要省事不少,一层一层检查元素代码的工作,全都省略了。这样下来基本套路都差不多,一般的静态网站根本不在话下,豆瓣、糗事百科、腾讯新闻等基本上都可以上手了。

掌握各种技巧,应对特殊网站的反爬措施

当然,爬虫过程中也会经历一些绝望,比如被封IP、比如各种奇怪的验证码、字体加密、userAgent访问限制、各种动态加载等等。

遇到这些反爬虫的手段,当然还需要一些的技巧来应对,常规的比如访问频率控制、使用代理IP池、字体反加密、抓包、验证码的OCR处理等等。

往往网站在开发和反爬虫之间会偏向前者,这也为爬虫提供了空间,掌握这些应对反爬虫的技巧,绝大部分的网站已经难不到你了。

学习scrapy,搭建工程化的爬虫

掌握前面的技术一般量级的数据和代码基本没有问题了,但是在遇到非常复杂的情况,可能仍然会力不从心,这个时候,强大的scrapy框架就非常有用了。

scrapy是一个功能非常强大的爬虫框架,它不仅能便捷地构建request,还有强大的selector能够方便地解析response,然而它较让人惊喜的还是它超高的性能,让你可以将爬虫工程化、模块化。

学会scrapy,你可以自己去搭建一些爬虫框架,你就基本具备爬虫工程师的思维了。

学习数据库基础,应对大规模数据存储

爬回来的数据量小的时候,你可以用文档的形式来存储,一旦数据量大了,这就有点行不通了。所以掌握一种数据库是必须的,学习目前比较主流的MongoDB就OK。

MongoDB可以方便你去存储一些非结构化的数据,比如各种评论的文本,图片的链接等等。你也可以利用PyMongo,更方便地在Python中操作MongoDB。

因为这里要用到的数据库知识其实非常简单,主要是数据如何入库、如何进行提取,在需要的时候再学习就行。

分布式爬虫,实现大规模并发采集

爬取基本数据已经不是问题了,你的瓶颈会集中到爬取海量数据的效率。这个时候,相信你会很自然地接触到一个很厉害的名字:分布式爬虫。

分布式这个东西,听起来很恐怖,但其实就是利用多线程的原理让多个爬虫同时工作,需要你掌握Scrapy+MongoDB+Redis这三种工具。

Scrapy前面我们说过了,用于做基本的页面爬取,MongoDB用于存储爬取的数据,Redis则用来存储要爬取的网页队列,也就是任务队列。

所以有些东西看起来很吓人,但其实分解开来,也不过如此。当你能够写分布式的爬虫的时候,那么你可以去尝试打造一些基本的爬虫架构了,实现更加自动化的数据获取。

尊重原创文章,转载请注明出处与链接:http://www.soxsok.com/wnews703186.html 违者必究! 以上就是关于“Python爬虫怎么学分哪几个阶段”的全部内容了,想了解更多相关知识请持续关注本站。